Optimisation sans contraintes

Résumé de section

-

Université: Khemis-Miliana

Département: Mathematiques

Niveau: L3 Mathématiques

Matière: Optimisation sans contraintesContenu de la matière :

-

Chapitre1: Quelques rappels de calcul différentiel, Convexité

1.1. Différentiabilité, gradient, matrice hessienn

1,2. Développement de Taylor

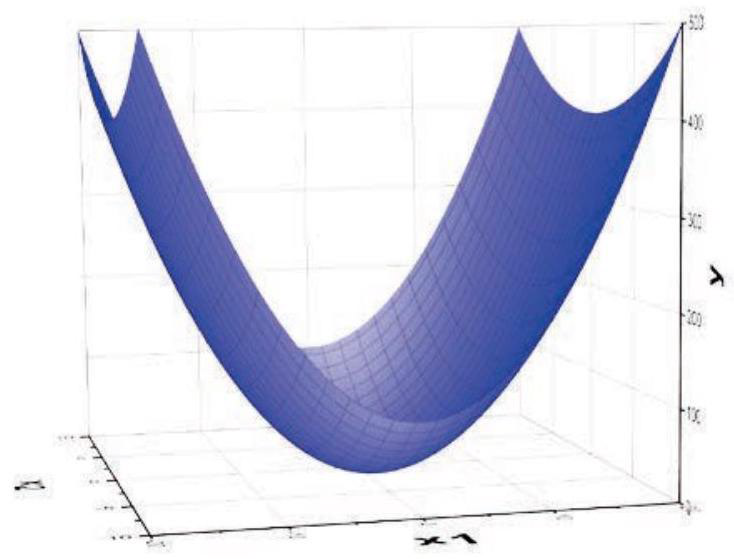

1,3. Fonctions convexesChapitre2 : Minimisation sans contraintes

2,1. Résultats d'existence et d'unicité

2.2. Conditions d'optimalité du premier ordre

2.3. Conditions d'optimalite du dexieme ordreChapitre3 : Algorithmes

3.1. Méthode du gradient

3.2. Méthode du gradient conjugué

3.3. Méthode de Newton

3.4. Méthode de relaxationMode d'évaluation : Examen (60%) , contrôle continu (40%)

-

1 .Notions de base de calcul différentiel dans R^n.

2. Calcul matricielle

3. Espace vectoriel

-

La matière propose une introduction à l'optimisation sans contraintes. Un étudiant ayant suivi ce cours saura reconnaître les outils et résultats de base en optimisation ainsi que les principales méthodes utilisées dans la pratique. Des séances de travaux pratiques sont proposées pour être notamment implémentés sous le logiciel de calcul scientifique Matlab et ce, afin d'assimiler les notions théoriques des algorithmes vues en cours.

-

Dans ce chapitre, on donne et on introduit les outils fonctionnels de base nécessaires pour l'optimisation sans contraintes.

-

Dans ce chapitre, on s'intéressant à la résolution de problème d’optimisation sans contrainte, on tente de répondre aux questions suivantes : Existet- il une solution du problème posé ? si oui, a-t-on unicité ? Comment la caractériser ? (conditions d’optimalité).

-

Dans ce chapitre on donne quelques algorithmes pour la résolution des problèmes d’optimisation sans contraintes où on va répondre aux questions suivantes: Comment calculer la solution optimal? et quel type d’algorithme choisir ?

-

- G. Allaire, Analyse numérique et optimisation, Edition 2002.

- M. Bergounioux, Optimisation et contrôle des systèmes linéaires, Dunod, Paris, 2001.

- M. Bierlaire, Introduction à l’optimisation différentiable, PPUR, 2006.

- O. Brun: Eléments d’optimisation, INSA, 2010.

- P. Ciarlet, Introduction a l’analyse numérique matricielle et à l’optimisation, Masson, 1988.

- Y. Dodge, Optimisation appliquée, Springer, 2005.

- A. David, R. Wismer, R. Chattergy: Introduction to nonlinear optimization: a problem-solving approach, North Holland, 1978.

- R. Horst, M. Panos, M.P. Nguyen V. Thoai: Introduction to global optimization, Kluwer Academic Publishers, 2000.

- J-B. Hiriart-Urruty, Optimisation et analyse convexe, exercices corrigés, EDP sciences, 2009.